A Simple Theoretical Model of Importance for Summarization

一、概述

整体思路:摘要的主要目的就是在损失最小信息量的情况下,最大限度表达原文信息量,因此基于信息论来研究摘要任务是合适的。然而信息论着重于研究信息的不确定性,容易忽略语言中的语义信息,因此直接应用信息论不适合。论文里将文本切分成最基本的语义单元,语义单元负责语义部分,而信息论只需要关注由语义单元构成的文本信息即可。(语义单元可以是字符、词、n-gram、具有更复杂语义语法内容的单元,也称为原子信息块。)文本则是用这些基本语义单元的概率分布来表示。

二、框架

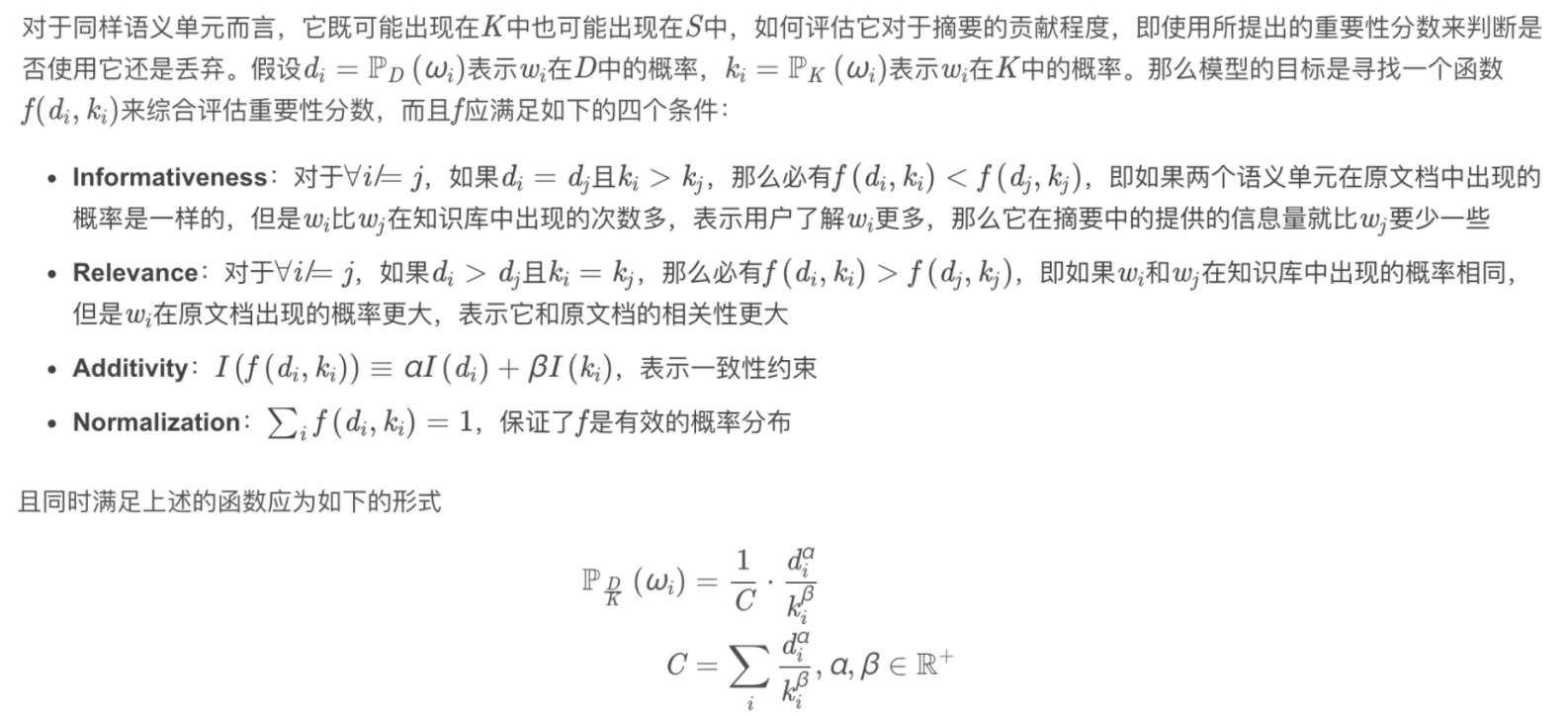

论文从四个不同的角度,在本质上对摘要本身做了分析。分别是冗余度(redundancy),相关性(relevance),informativeness,重要性(importance)。其中,重要性是论文新突出的理念,它结合了其余三个概念的内容,并进行了公式化。

1. 相关性Relevance

目前大部分模型对摘要抽取或生成的目标都可近似为相关性。对于有监督学习训练来说,抽取式摘要的训练数据标注了哪些句子是摘要句。最后任务转化为对每个句子做二分类问题,而生成式摘要的seq2seq模型中,也是与标注的人工摘要进行语义单元上的差异计算。对于无监督学习来说,大部分的方法的建模目标都是相关性。

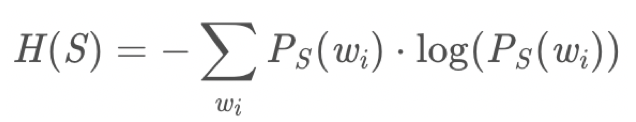

通过阅读摘要,应该降低对原文的不确定感,摘要文本应当以最小的信息损失来推断原文文档。从统计学角度来看,摘要和原文档都各自满足一定的概率分布,而分布之间的接近程度可以简单的使用交叉熵(cross-entropy)衡量。CE指的是交叉熵的函数,注意到这里有个负号,因为交叉熵越小,表示摘要和文档的差异越小,那么相关性应当越强。

REL(S,D) = −CE(S,D)

2. 冗余度Redundancy

如果简单的使用相关性来对文档中的句子进行排序,然后选择相关性最高的某些句子来生成摘要,但由于相关性分数接近的句子表述的内容通常也是接近的,因此摘要的冗余度就会很高。而一个好的摘要应该是包含不同的信息,而不是大量相似的信息,而冗余度可以使用熵进行描述。

那么冗余度可以表示为Red(S)=−H(S) 。建模的目标是冗余度尽量小,那么表示S SS的熵值越大,表示文本的不确定性越好,所包含的信息量也越大,对应的冗余度也就越小。

3. 信息量Informativeness

根据论文的叙述,这个概念假设当前有一个背景知识库K,此时需要对文档D进行摘要抽取,那么候选摘要S对于K来说,应当新增尽可能多的信息,才能让读者在阅读摘要后获取最多的新信息。如果摘要句子说的都是用户早就知道的事情,那么阅读摘要没有给用户产生任何价值。

相关性和冗余度只是在当前处理文档的范围内进行建模,但是人类的语言是有庞大的常识库的。只使用相关性和冗余度有其局限性,因此才引入了informativeness的概念。那么如何度量这个概念呢?informativeness的目标是让S尽可能与K不同,同时K也是由语义单元组成的文本语料集合,因此也可以用Pk来表示K的概率分布,与相关性类似,使用交叉熵来衡量两个概率分布的差异性。

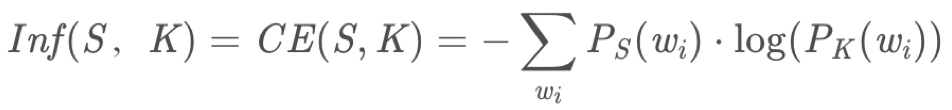

4. 重要性Importance

针对的是语义单元,目标是计算每个语义单元的重要性分数,在构造摘要时,根据每个语义单元的评分来丢弃不需要的语义单元。

5. 整合四个维度

三、总结

纯理论论文,没有具体模型,定性分析文本摘要的生成与评估。

参考文献

- 本文作者: 鱼咸滚酱

- 本文链接: https://github.com/WangMeng2018/WangMeng2018.github.io/tree/master/2020/02/16/Report-A-Simple-Theoretical-Model-of-Importance-for-Summarization/

- 版权声明: 本博客所有文章除特别声明外,均采用 Apache License 2.0 许可协议。转载请注明出处!