Self-Supervised Learning for Contextualized Extractive Summarization

一、概述

引入三个辅助预训练方法Mask、Replace、Switch,以自监督的方式来捕获文档级的上下文信息,属于抽取式摘要方式。

代码:https:// github.com/hongwang600/Summarization

二、模型

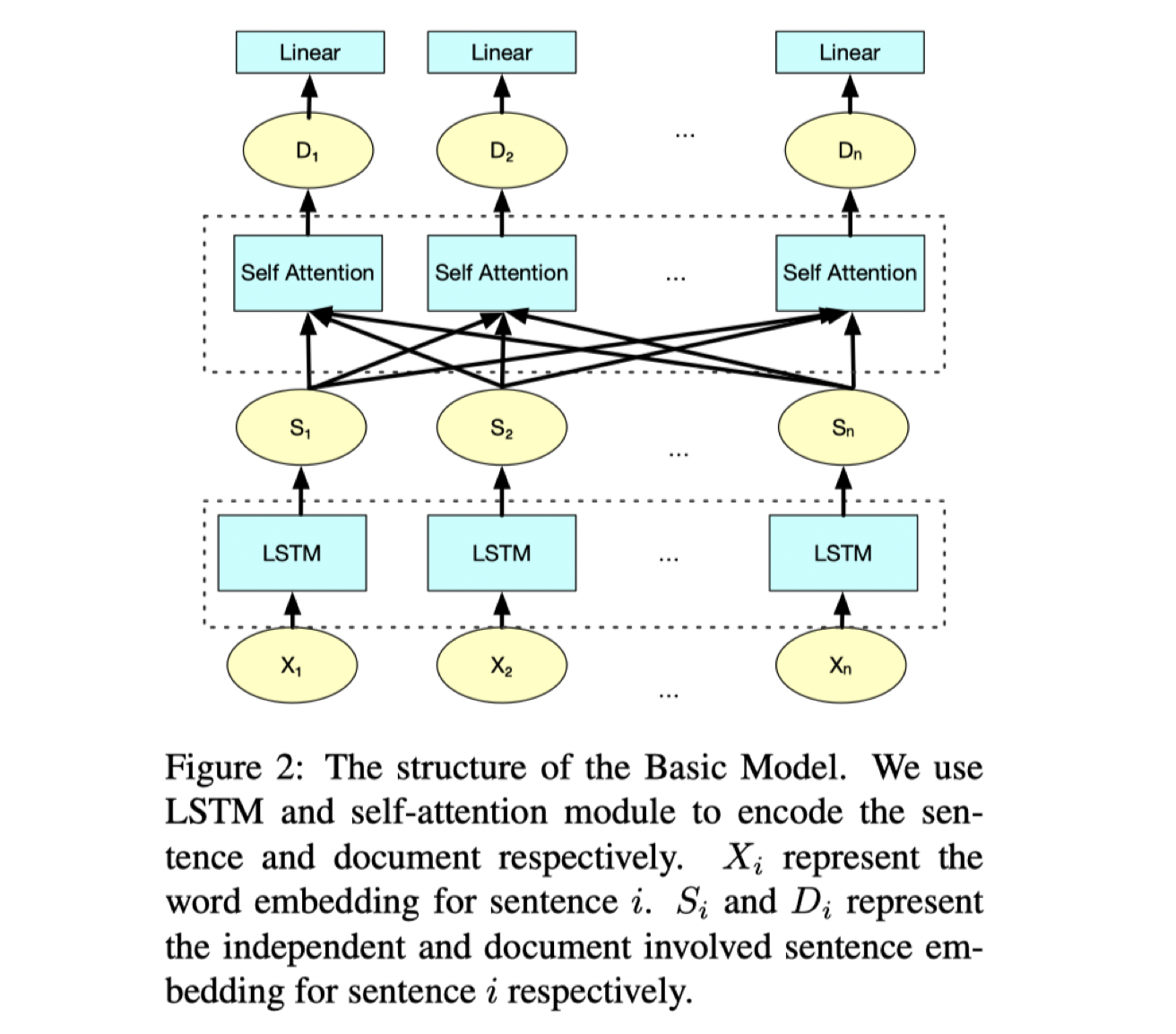

这里使用了一个基础模型:一个句子编码器和一个文档级的自注意力机制。句子编码器是一个双向的LSTM,输入是句子序列的Embedding,输出是句子表示;再经过Self-Attention层,输出学习了全局上下文信息的句子表示;再通过线性层判断是否选择该句子。

三、预训练方法

Mask

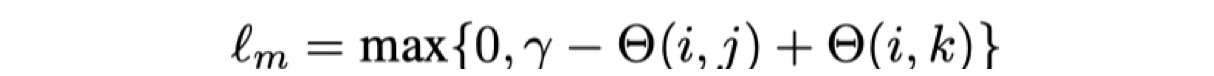

Mask任务就是从候选池中预测Masked的句子。首先,以一定的概率Mask文档中的句子,并将Masked句子存入候选池。其次,用相同的句子编码器获取候选池中句子的表示。接着,模型需要预测每一个Mask位置缺失的句子,会先将Masked句子用

代替,并计算其结合上下文信息的表示。最后,再计算两个表示的余弦相似度。

为了训练模型,使用排序的损失函数来最大化预测句子与其他句子的边距。

Replace

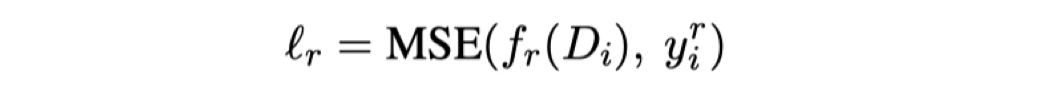

以一定的概率用其他文档的句子替换本文档中的句子,并使用一个线性层来预测句子是否被替换。

Switch

与Replace类似,只不过是与同一文档中的句子进行交换。

四、实验结果

效果的确提升了,而且收敛速度更快。Switch方法的表现最好,但是感觉没有达到读者预想的目标。

- 本文作者: 鱼咸滚酱

- 本文链接: https://github.com/WangMeng2018/WangMeng2018.github.io/tree/master/2020/02/17/Report-Self-Supervised-Learning-for-Contextualized-Extractive-Summarization/

- 版权声明: 本博客所有文章除特别声明外,均采用 Apache License 2.0 许可协议。转载请注明出处!