HIBERT: Document Level Pre-training of Hierarchical Bidirectional Transformers for Document Summarization

一、概述

HIBERT:HIerachical Bidirectional Encoder Representations from Transformers

整体思路:抽取式摘要,借鉴了Transformer的思想,利用大量的无标注数据进行预训练,学习句子和文档的表达,进而进行筛选句子作为摘要内容。

二、模型

2.1 Document Representation

为了获取文档的表达,这里使用了两个编码器。一个是句子编码器,用于转换文档中的句子;另一个是文档编码器,根据上下文语句学习句子表达。两者都使用Transformer,每一个词向量随机初始化,并且采用了sine-cosine位置编码;其次,Transformer会将词编码转换成一个高层表达序列,默认最后一个隐藏层表元素作为句子表示,比如

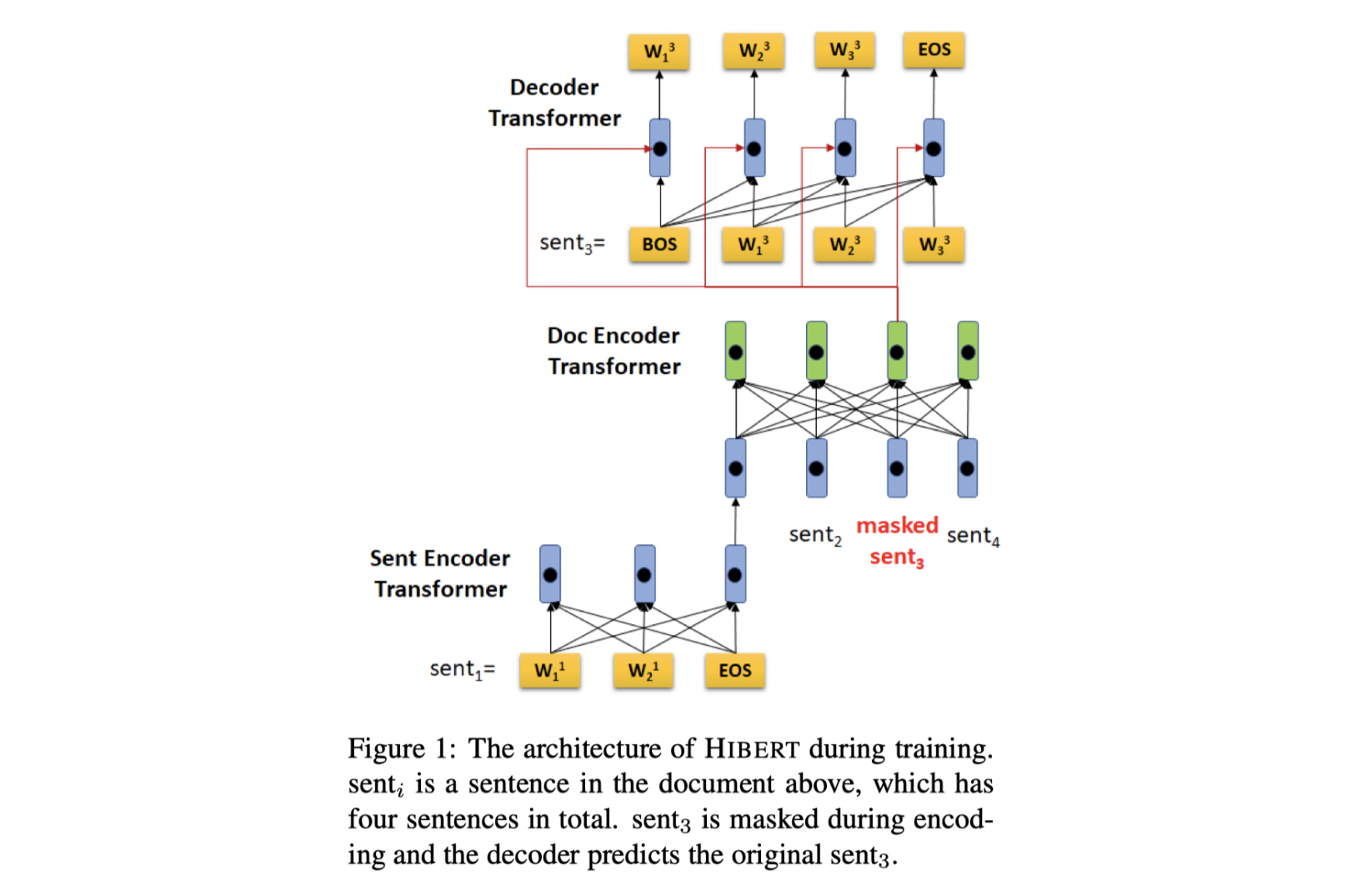

2.2 Pre-training

使用双向信息,大致分两步:

- Document Masking

以15%的概率Mask句子,一个被Masked的句子,会做如下处理,三种方式中选择一种:80%的语句会将其中的每一个词语包括标点都转换成[Mask]标识;10%的语句会保持不变,这种方式能够模拟测试时不Mask的情况;10%的语句会随机替换成其他语句,这种方式可以添加一些噪音,提高模型的鲁棒性。

- Sentence Prediction

被Masked的语句的索引会被记录下来。首先,使用前面的编码器获得语句的上下文信息表示;在预测时,一个一个词语的进行预测,第一个默认是

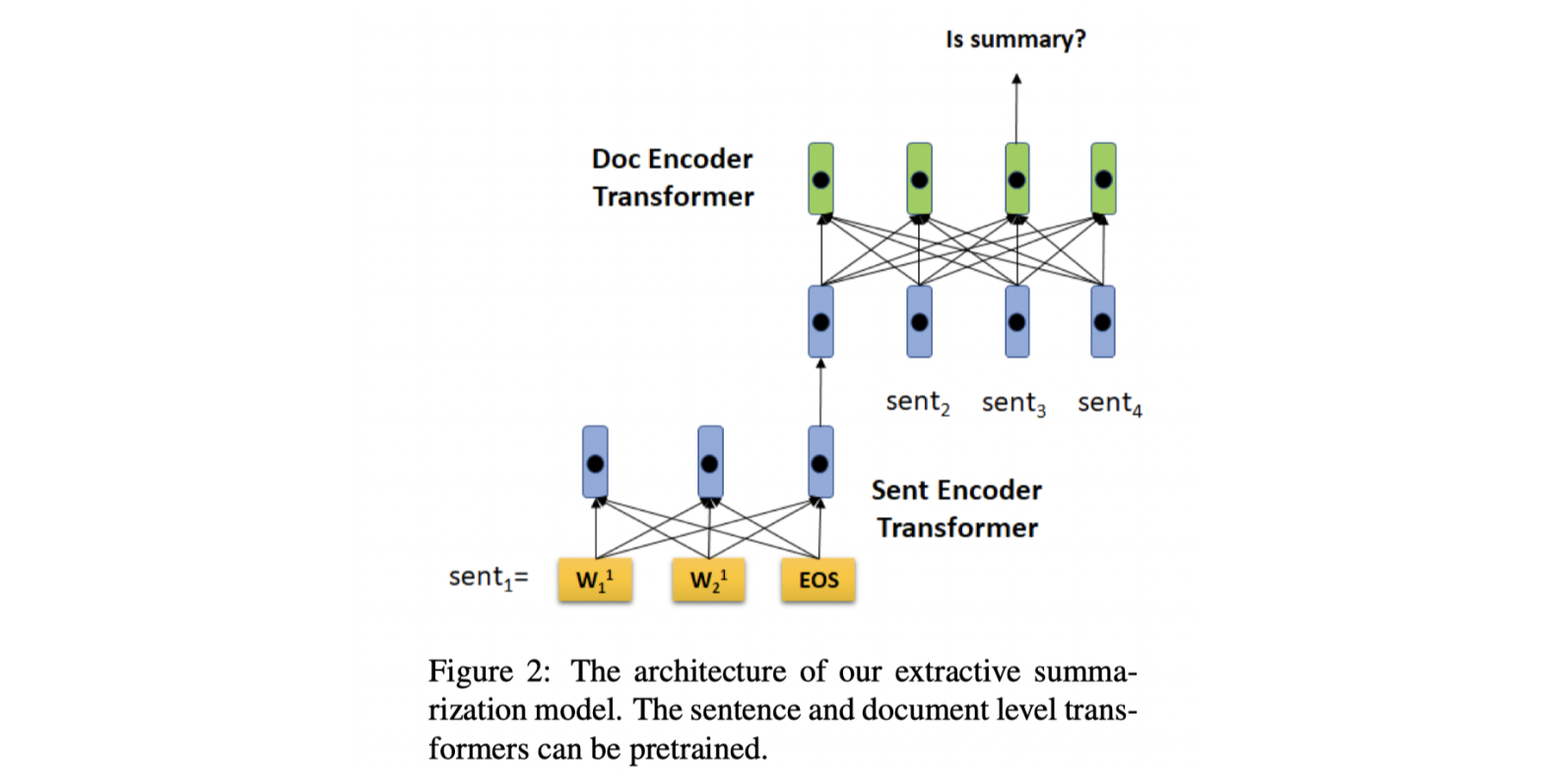

2.3 Extractive Summarization

建模成序列标注问题,在编码器后加一个线性层和一个SoftMax。

三、总结

模型训练大致分为三个阶段:第一个阶段,开放域的预训练,使用大量的无特定领域的无标注数据;第二个阶段,特定域的预训练,使用专门数据集进行预训练,比如用于文本摘要的数据集;第三个阶段,微调HIBERT进行语句序列标注的预测。

实验效果不错。

- 本文作者: 鱼咸滚酱

- 本文链接: https://github.com/WangMeng2018/WangMeng2018.github.io/tree/master/2020/02/18/Report-HIBERT-Document-Level-Pre-training-of-Hierarchical-Bidirectional-Transformers-for-Document-Summarization/

- 版权声明: 本博客所有文章除特别声明外,均采用 Apache License 2.0 许可协议。转载请注明出处!